# MoE架构

深度解析混合专家模型设计理念、训练技巧与推理优化,分享从百亿到千亿参数规模的落地经验

今日更新:0

栏目文章数:1

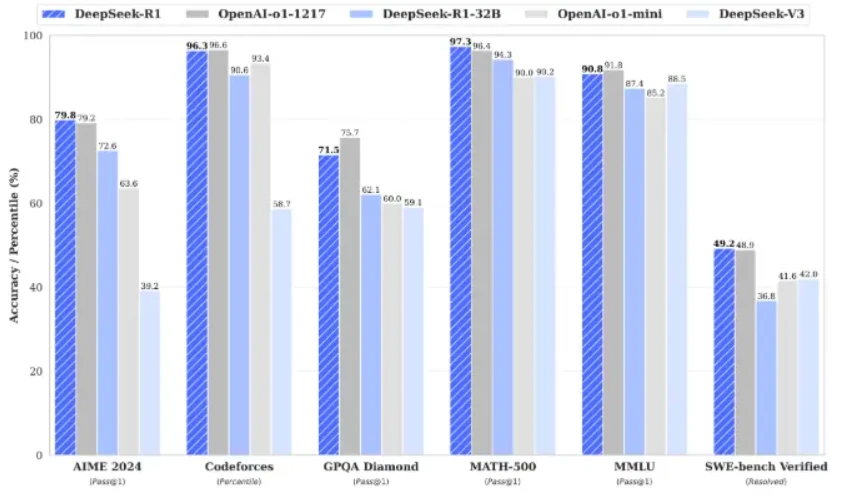

高效深度求索:DeepSeek全系开源模型正式发布,涵盖671B MoE至轻量化版本

DeepSeek是由国内顶尖团队自主研发的高效开源人工智能模型系列,在自然语言处...