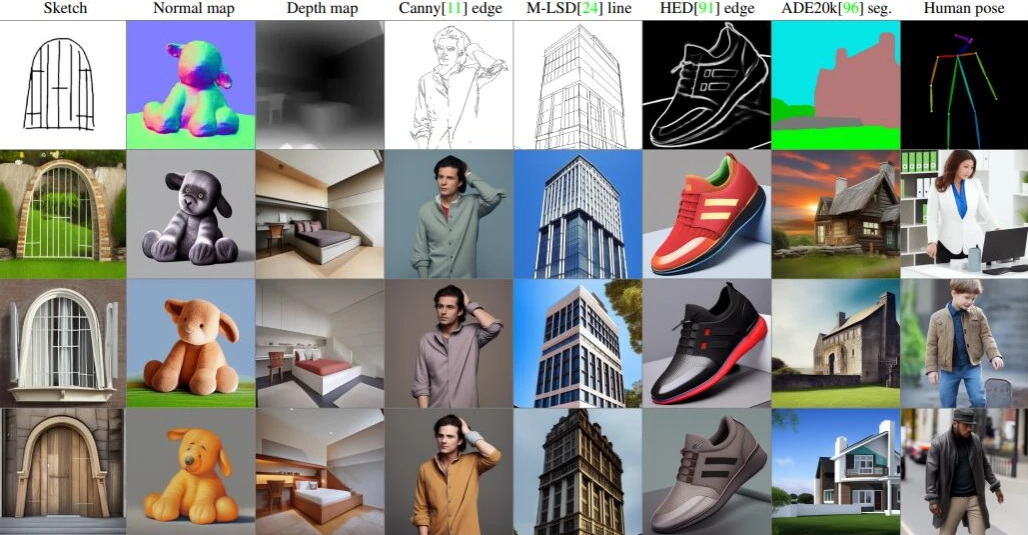

ControlNet 是Stable Diffusion的神经网络扩展结构,用于精确控制图像生成过程。该框架基于条件生成对抗网络(CGANs),通过复制主扩散模型权重到可训练副本和锁定副本中,并用零卷积层连接。ControlNet1.1为当前正式版本,架构与 1.0一致。文章提供多类模型文件,如 FLUX 系列、SDXL专用 OpenPose模型,以及ControlNet-v1.1的功能模型组(包括图像编辑、深度感知、边缘控制等),并强调使用时需将 .yaml配置文件与模型文件同名放置在同一目录。

— 此摘要由AI分析文章内容生成,仅供参考。

ControlNet 是 Stable Diffusion 的一种神经网络扩展结构,专门用于对图像生成过程进行精细化控制。该技术基于条件生成对抗网络(CGANs),通过复制主扩散模型的权重到“可训练副本”和“锁定副本”中,实现对生成内容的精确约束。锁定副本保留原有网络能力,可训练副本则学习特定任务的条件控制,两者通过“零卷积”层连接,确保在各种数据集上都能稳定运行。

ControlNet 1.1 为当前正式版本,其架构与 1.0 完全一致,但需注意每个模型都附有对应的 .yaml 配置文件,使用时需将配置文件与模型文件置于同一目录下,并确保文件名一致。

模型文件清单

🔄 FLUX 系列 ControlNet 模型

flux-canny-controlnet-v3.safetensorsflux-depth-controlnet-v3.safetensorsflux-hed-controlnet-v3.safetensors

👤 SDXL 专用 OpenPose 控制模型

controlnet-openpose-sdxl-1.0_diffusion_pytorch_model.bincontrol-lora-openposeXL2-rank256.safetensorsOpenPoseXL2.safetensors

🧩 ControlNet-v1.1 功能模型组

包含多种控制类型的模型及对应配置文件(.yaml 文件需与模型同名放置):

图像编辑类

control_v11e_sd15_ip2p.pth(图像指令编辑)control_v11e_sd15_shuffle.pth(图像混洗)

结构与深度感知类

control_v11f1e_sd15_tile.pth(分块处理)control_v11f1p_sd15_depth.pth(深度图控制)control_v11p_sd15_depth_anything.safetensors(通用深度感知)

边缘与线条控制类

control_v11p_sd15_canny.pth(Canny边缘检测)control_v11p_sd15_lineart.pth(线稿控制)control_v11p_sd15s2_lineart_anime.pth(动漫线稿)control_v11p_sd15_scribble.pth(涂鸦控制)control_v11p_sd15_softedge.pth(软边缘控制)

语义与姿态识别类

control_v11p_sd15_inpaint.pth(局部重绘)control_v11p_sd15_mlsd.pth(直线检测)control_v11p_sd15_normalbae.pth(法线贴图)control_v11p_sd15_openpose.pth(人体姿态)control_v11p_sd15_seg.pth(语义分割)

📀 ControlNet-v1.0 基础模型组

controlnet_checkpoint.ckpt(基础检查点)control_sd15_canny.pthcontrol_sd15_depth.pthcontrol_sd15_hed.pthcontrol_sd15_mlsd.pthcontrol_sd15_normal.pthcontrol_sd15_openpose.pthcontrol_sd15_scribble.pthcontrol_sd15_seg.pth

🧬 其他衍生模型

outfitToOutfit_v20.safetensors+outfitToOutfit_v20.yaml(服装转换)controlnetxlCNXL_tencentarcOpenpose.safetensors(腾讯ARC姿态识别)

提示:使用前请确保正确放置 .yaml 配置文件,并与模型文件保持同名,以保证 ControlNet 正常运行。

评论列表 (0条):

加载更多评论 Loading...